- Die neuesten Vorhersagen zur Entwicklung von Künstlicher Allgemeiner Intelligenz (AGI) sind umstritten, mit erheblichen Fortschritten bis 2027 oder 2028. Elon Musk äußert Besorgnis über die potenzielle Bedrohung durch KI, gibt aber zu, dass die methodische Vergrößerung von Chatbots nicht zu AGI führen wird. Die Gefahren von KI resultieren oft aus unbedarftem oder absichtlichem Missbrauch durch Menschen, wie Beispiele aus der Rechtsbranche zeigen. Die Verbreitung gezielt manipulativer Inhalte, wie durch Microsofts „Designer“-KI-Tool, nimmt zu und weltweit werden Gesetzgebungsverfahren dagegen eingeleitet. Die Herausforderungen liegen in der Verantwortung des Menschen beim Umgang mit KI-Anwendungen und erfordern ein koordiniertes Vorgehen von Unternehmen, Regierungen und der Gesellschaft.

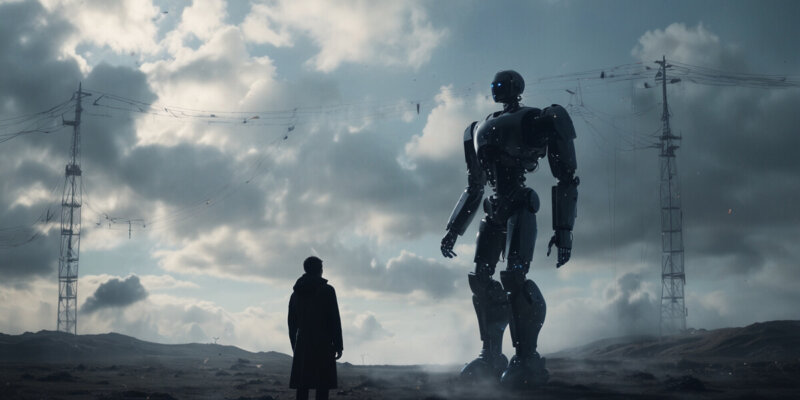

Die neuesten Vorhersagen über die Entwicklung von Künstlicher Allgemeiner Intelligenz (AGI) sind umstritten. Einige Fachleute prophezeien erhebliche Fortschritte bis 2027 oder 2028. Elon Musk, ein prominenter Verfechter technologischer Innovationen, hat seine Besorgnis über die potenzielle Bedrohung durch KI geäußert und gibt zu, dass ihn diese Thematik schlaflose Nächte bereitet. Dennoch zeigt sich, dass die methodische Vergrößerung und Verstärkung von Chatbots alleine nicht zu AGI führen wird. Stattdessen steht die Menschheit 2025 vor erheblichen Risiken durch den Missbrauch solcher Technologien. Diese Gefahren entstammen nicht der künstlichen Superintelligenz an sich, sondern dem unbedarften oder absichtsvollen Missbrauch durch Menschen.

Bedeutung der Fehlanwendung

Beispiele für unbedarften Missbrauch zeigen sich schon jetzt in der Rechtsbranche. Nach der Einführung von ChatGPT wurden mehrere Anwälte sanktioniert, da sie auf KI-generierte, fehlerhafte Schriftsätze zurückgriffen. Einer von ihnen war der Anwalt Chong Ke, der nach Einreichung von erfundenen Fällen gezwungen wurde, die Kosten des gegnerischen Anwalts zu übernehmen. Steven Schwartz und Peter LoDuca wurden wegen falscher Zitate mit einer Geldstrafe belegt. Zachariah Crabill erlitt eine einjährige Suspendierung, nachdem er Gerichtsfälle genutzt hatte, die von ChatGPT ausgedacht worden waren und einem „Rechtspraktikanten“ die Schuld gab. Diese Fälle unterstreichen, wie schnell sich solche Missbräuche häufen.

Die Gefahr intentionaler Täuschungen

Andere Fehlanwendungen sind gezielt. Im Januar 2024 überfluteten sexuell explizite Bilder, generiert mit Microsofts „Designer“-KI-Tool, die sozialen Medien. Obwohl Schutzmaßnahmen zur Verhinderung realitätsgetreuer Abbildungen vorhanden waren, konnte durch einfache Rechtschreibfehler die Erkennung umgangen werden. Microsoft hat dieses Problem mittlerweile korrigiert, aber dies verdeutlicht die Zunahme ungewollter Tiefenfakes. Diese Täuschungen nehmen zu, auch weil Open-Source-Tools zur Erstellung solcher Inhalte öffentlich zugänglich sind. Weltweit laufen Gesetzgebungsverfahren, um dieser Entwicklung entgegenzuwirken, deren Effektivität allerdings bisher unklar bleibt.

Derweil nutzen Unternehmen die allgemeine Verwirrung aus, um fragwürdige Produkte als „KI-gestützt“ zu verkaufen, sodass schwerwiegende Fehlentscheidungen fällig sind. Ein Einstellungsunternehmen behauptete, mit KI die Eignung von Bewerbern anhand von Videointerviews vorhersagen zu können. Eine Studie zeigte jedoch, dass das System bereits durch das Tragen einer Brille oder Anpassen des Hintergrundes getäuscht werden kann. In anderen Bereichen wie dem Gesundheitswesen oder im Finanzsektor führt der Einsatz von KI zur Verweigerung von Chancen, was weitreichende Konsequenzen für das Leben der Betroffenen haben kann.

Schlachten der Verwirrung und Verantwortung

Die Herausforderungen, die sich durch den Missbrauch von KI in Zukunft ergeben werden, liegen nicht in deren Eigenständigkeit, sondern darin, wie sie durch Menschenhand angewandt wird. Fälle, in denen KI scheinbar effektiv zu sein scheint, werden immer weiter hinterfragt – sei es durch die Überbeanspruchung ihrer vermeintlichen Fähigkeiten oder durch die bewusste Irreführung durch unrechtmäßige Anwendungen wie bei Deepfakes. Die Schwere dieser Problematik zu mildern, erfordert ein koordiniertes Vorgehen von Unternehmen, Regierungen und der Gesellschaft, das sich nicht in irrealen, dystopischen Vorstellungen verliert.